Så här installerar du 12c Release 2 Grid och RAC Database på RHEL 7.x

Summary: Steg och bilder för att hjälpa dig installera Oracle 12c version 2 Grid och RAC Database på RHEL 7.x

Instructions

1. Program- och maskinvarukrav

1.1. Maskinvarukrav

- Oracle kräver minst 8 GB fysiskt minne

- Växlingsutrymmet är proportionerligt med mängden RAM som finns allokerat i systemet

| RAM | Växlingsutrymme |

| Mellan 1,5 GB och 16 GB | Lika med RAM-storlek |

| Mer än 16 GB | 16 GB |

Om du aktiverar HugePages bör du dra av minnet som är allokerat till HugePages från tillgängligt RAM innan du beräknar växlingsutrymme

Om du aktiverar HugePages bör du dra av minnet som är allokerat till HugePages från tillgängligt RAM innan du beräknar växlingsutrymme

- Följande tabell beskriver diskutrymmet som krävs för en Oracle-installation

| Plats för programvaruinstallation | Minsta krav på diskutrymme |

| Rutnätsinfrastrukturens startsida | Minst 8 GB diskutrymme |

| Oracle-databasens startsida | Minst 6,4 GB diskutrymme |

| Delat lagringsutrymme på disken | Storlek på databasen och flashåterställningsområdet |

- Oracles tillfälliga utrymme (/tmp) måste vara minst 1 GB storlek

- En skärm med stöd för en upplösning på 1 024 x 768 för korrekt visning av Oracle Universal Installer (OUI)

1.2 Nätverkskrav

- Det rekommenderas att se till att varje nod innehåller minst tre nätverksgränssnittskort (NIC:er). Ett NIC för offentligt nätverk och två NIC:er för privata nätverk för att säkerställa tillgänglighet av Oracle RAC-klustret. Om du ska använda Automatic Storage Management (ASM) i klustret behöver du ha minst ett Oracle ASM-nätverk. ASM-nätverket kan dela nätverksgränssnittet med ett privat nätverk.

- Namn på offentliga och privata nätverk och ASM-gränssnitt måste vara samma på alla noder. Om EM1 exempelvis används som publikt gränssnitt på nod ett måste alla andra noder ha EM1 som publikt gränssnitt

- Alla offentliga gränssnitt för vardera nod bör kunna kommunicera med alla noder i klustret.

- Alla privata gränssnitt och ASM-gränssnitt för varje nod bör kunna kommunicera med alla noder i klustret

- Värdnamnet för varje nod måste följa RFC 952-standarden (www.ietf.org/rfc/rfc952.txt). Värdnamn som innehåller ett understreck (”_”) är inte tillåtna

1.3. Krav för operativsystem

- Red Hat Enterprise Linux (RHEL) 7.x (Kernel 3.10.0-693.el7.x86_64 eller högre)

1.3.1. Operativsystem – diskpartition

Nedan visas de rekommenderade posterna för diskpartition när du installerar RHEL 7 med hjälp av en snabbstartsfil på de lokala hårddiskarna med minst 1,2 TB tillgängligt utrymme

part /boot --asprimary --fstype="xfs" --ondisk=sda --size=1024

part pv.1 --size=1 --grow --ondisk=sda --asprimary

volgroup rhel7 pv.1

logvol / --name=root --fstype=xfs --vgname=rhel7 --size=51200

logvol swap --fstype swap --name=swap --vgname=rhel7 --size=17408

logvol /home --name=home --fstype=xfs --vgname=rhel7 --size=51200

logvol /var --name=var --fstype=xfs --vgname=rhel7 --size=20480

logvol /opt --name=opt --fstype=xfs --vgname=rhel7 --size=20480

logvol /tmp --name=tmp --fstype=xfs --vgname=rhel7 --size=5120

logvol /u01 --name=u01 --fstype=xfs --vgname=rhel7 --size=1 --grow

2. Förbereda servrar för Oracle-installation

Innan du installerar Grid och Database måste du installera nedanstående distributionsskript från Dell EMC som konfigurerar miljön för

installation av Oracle-databaser.

2.1. Ansluta system till Red Hat Network (RHN)/Unbreakable Linux Network (ULN) Repository

Alla nödvändiga RPM-filer måste installeras innan någon GRID/DB-installation utförs.

Steg 1:

- rhel-7-server-optional-rpms

- rhel-7.x

Konfigurera ett lokalt yum-datalager för att automatiskt installera resten av de nödvändiga RPM-filerna för att utföra GRID-/DB-installationen

- Den rekommenderade konfigurationen är att hantera filerna över http med hjälp av en Apache-server (paketnamn: httpd). Det här avsnittet handlar om att använda lokal filsystemslagring som värd för databasfilerna. Även om det finns andra alternativ för placering av databasfilerna tar vi inte upp dem i det här dokumentet. Vi rekommenderar starkt att du använder lokal filsystemslagring för snabb och enkel hantering.

mkdir /media/myISO

mount -o loop myISO.iso /media/myISO

- Om du vill installera och konfigurera http-daemon konfigurerar du den dator som ska vara värd för lagringsplatsen för alla andra datorer så att de använder DVD-avbildningen lokalt. Skapa filen /etc/yum.repos.d/local.repo och ange följande:

[local]

name=Local Repository

baseurl=file:///media/myISO

gpgcheck=0

enabled=0

- Nu installerar vi Apache-tjänstens daemon med följande kommando, som också tillfälligt aktiverar den lokala databasen för beroendematchning:

yum -y install httpd --enablerepo=local

- Om du vill använda Apache för att hantera databasen kopierar du innehållet på DVD-skivan till en publicerad webbkatalog. Kör följande kommandon som root (se till att byta ut myISO med namnet på ditt ISO-kommando):

cp -R /media/myISO/* /var/www/html/myISO

- Det här steget är bara nödvändigt om du kör SELinux på den server som är värd för databasen. Följande kommando bör köras som root och kommer att återställa rätt SELinux-kontext till de kopierade filerna:

- Det sista steget är att samla in DNS-namnet eller IP-adressen för den server som är värd för lagringsplatsen. DNS-namnet eller IP-adressen för värdservern kommer att användas för att konfigurera yum-databasens repo-fil på klientservern. Följande är en lista över en exempelkonfiguration med RHEL 7.x-serverns media och hålls i konfigurationsfilen: /etc/yum.repos.d/myRepo.repo

[myRepo]

name=RHEL 7.x Base ISO DVD

baseurl= http://reposerver.mydomain.com/myISO

enabled=1

gpgcheck=0

- Installera RPM-filen compat-libstdc++ manuellt med hjälp av RPM- eller yum-kommando i katalogen där RPM-filerna kopieras.

Ex: rpm -ivh

yum localinstall -y

Steg 3:

- Installera RPM-filerna compat-libstdcc++ genom att köra följande kommando

yum install –y compat-libstdc++.i686

yum install –y compat-libstdc++.x86_64

- Ladda ner/kopiera RPM:er från DELL genom att gå till Dell Oracle Deployment RPMs for Oracle 12cR2 on RHEL7.x för RH till servrarna där GRID/DB-installationer ska utföras. Listan över RPM:er är följande och endast nödvändiga RPM:er ska hämtas

dell-redhat-rdbms-12cR2-preinstall-2018.06-1.el7.noarch.rpm

dell-redhat-rdbms-utilities-2018.06-1.el7.noarch.rpm

dell-redhat-rdbms-12cR2-preinstall-2018.06-1.el7.noarch.rpm är skapat för att utföra följande

- Avaktivera transparent_hugepages in grub2.cfg

- Avaktivera numa in grub2.cfg

- Skapa Oracle-användare och grupper oinstall & DBA

- Ange sysctl kernel-parametrar

- Ange användargränser (nofile, nproc, stack) för Oracle-användare

- Ange NOZEROCONF=yes in /etc/sysconfig/network file

- Skapa rutnätsanvändare och asmadmin, asmdba, asmoper, backupdba, dgdba, kmdba för grupper

- Ange användargränser (nofile, nproc, stack) för rutnätanvändare.

- Ange sysctl kernel-parametrar

- Ange RemoveIPC =no för att säkerställa att semaforerna som är angivna förför användare som går förlorade efter att användaren loggat ut

- Installera dessa två RPM:er

yum localinstall –y dell-redhat-rdbms-utilities-2018.06-1.el7.noarch.rpm

2.2. Konfigurera nätverket

2.2.1. Offentligt nätverk

Så här konfigurerar du det offentliga nätverket på varje nod

- Logga in som root.

- Gå till /etc/sysconfig/network-scripts och redigera ifcfg-em#-filen där # är nätverksenhetens nummer

NAME="Oracle Public"

DEVICE= "em1"

ONBOOT=yes

TYPE= Ethernet

BOOTPROTO=static

IPADDR=<routable IP address>

NETMASK=<netmask>

GATEWAY=<gateway_IP_address>

- Ange värdnamnet via kommandot nedan

hostnamectl set-hostname <host-name>

där <host-name> är det värdnamn vi använder för installationen

- Skriv service network restart för att starta om nätverkstjänsten

- Skriv ifconfig för att verifiera att IP-adresserna är korrekt angivna

- Kontrollera din nätverkskonfiguration genom att pinga varje offentlig IP-adress från en klient på det LAN som inte är en del av klustret

- Anslut varje nod för att verifiera att det offentliga nätverket fungerar. Ange SSH för att verifiera att kommandot för säkert skal (ssh) fungerar

2.2.2. Privat nätverk

Exemplet nedan är en instruktion med steg för steg för att aktivera redundant sammankoppling med hjälp av HAIP i en ny Oracle 12c Grid-infrastruktursinstallation

- Redigera filen /etc/sysconfig/network-scripts/ifcfg-emX, där X är antalet em-enheter, ifcfg-emX-konfigurationsfiler för nätverksadaptrar som ska användas för din privata sammankoppling.

DEVICE=em2

BOOTPROTO=static

HWADDR=

ONBOOT=yes

NM_CONTROLLED=yes

IPADDR=192.168.1.140

NETMASK=255.255.255.0

DEVICE=em3

HWADDR=

BOOTPROTO=static

ONBOOT=yes

NM_CONTROLLED=yes

IPADDR=192.168.1.141

NETMASK=255.255.255.0

- När du har sparat båda konfigurationsfilerna startar du om nätverkstjänsten med hjälp av kommandona nedan

nmcli connection reload

nmcli device disconnect em2

nmcli connection up em2

- Upprepa stegen för varje gränssnitt som har ändrats.

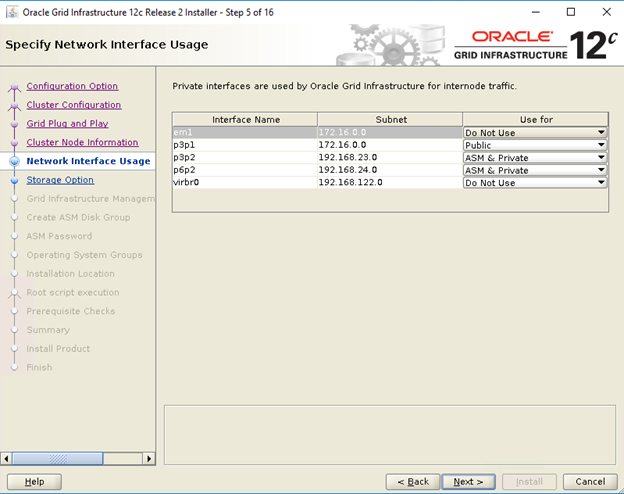

- Genom att slutföra stegen ovan har systemet nu förberetts för aktivering av HAIP med hjälp av installationsprogrammet för Oracle-rutnätsinfrastruktur. När du har slutfört Oracles alla förutsättningar och är redo att installera Oracle behöver du markera em2 och em3 som privata gränssnitt på skärmen Network Interface Usage

- I det här steget aktiverar du redundant sammankoppling när Oracle-rutnätsinfrastrukturen har slutförts och körs

2.2.3. Oracle Flex ASM-nätverk

Oracle Flex ASM kan antingen använda samma privata nätverk som Oracle Clusterware eller sina egna särskilda privata nätverk. Varje nätverk kan klassificeras som OFFENTLIGT eller PRIVAT+ASM, eller PRIVAT eller ASM

2.2.4. Krav på IP-adress och namnmatchning

Vi kan konfigurera klusternodernas IP-adress med ett av följande alternativ

- Domännamnsserver (DNS)

2.2.4.1. Domännamnsserver (DNS)

Så här konfigurerar du Oracle 12c RAC med hjälp Oracle (utan GNS):

I tabellen nedan beskrivs de olika gränssnitten, inställningar för IP-adress samt matchningar i ett kluster

|

Gränssnitt

|

Typ

|

Lösning

|

|

Publik

|

Statisk

|

DNS

|

|

Privat

|

Statisk

|

Krävs inte

|

|

ASM

|

Statisk

|

Krävs inte

|

|

Nod, virtuell IP

|

Statisk

|

Krävs inte

|

|

GENOMSÖKNING av virtuell IP

|

Statisk

|

Krävs inte

|

Konfigurera en DNS-server

Så här konfigurerar du ändringar på en DNS-server för ett Oracle 12c-kluster med hjälp av DNS (utan GNS):

Konfigurera GENOMSÖKNINGSNAMNETS matchning på DNS-servern. Ett GENOMSÖKNINGSNAMN som konfigurerats på DNS-servern med hjälp av Round Robin-policyn bör lösa de tre offentliga IP-adresserna (rekommenderas), men det minsta kraven är en offentlig IP-adress

Till exempel

scancluster IN A 192.0.2.1

IN A 192.0.2.2

IN A 192.0.2.3

Där scancluster är det GENOMSÖKNINGSNAMN som tilldelas under Oracle Grid-installation

Konfigurera en DNS-klient

Så här konfigurerar du de ändringar som krävs på klusternoderna för namnmatchning:

- Du måste konfigurera resolv.conf på noderna i klustret för att bevara namnserverposter som är matchningsbara med DNS-servern.

nmcli connection modify ipv4.dns ipv4.dns-search

- Kontrollera att orderkonfigurationen /etc/nsswitch.conf kontrollerar namntjänsteordning. I vissa konfigurationer kan NIS orsaka problem med Oracle SCAN-adressmatchningen. Vi rekommenderar att du placerar NIS-posten i slutet av söklistan.

Till exempel, hosts: dns files nis

3. Förbereda delad lagring för fristående Oracle RAC-installation

Oracle RAC kräver delade LUN:er för lagring av Oracle Cluster Registry (OCR), röstningsdisk, Oracle Database-filer och Flash Recovery Area (FRA). I följande tabell visas den vanliga rekommenderade designen av lagringsvolymen för Oracle 12c-databasen

| Databasens volymtyp/syfte | Antal volymer | Volymstorlek |

| OCR/VOTE | 3 | 50 GB vardera |

| DATA | 4 | 250 GB1 vardera |

| REDO2 | 2 | Minst 50 GB vardera |

| FRA | 1 | 100 GB3 |

| TEMP | 1 | 100 GB |

1 – Justera varje volymstorlek baserat på din databas. 2 – Minst två REDO ASM-diskgrupper rekommenderas, var och en med minst en lagringsvolym. 3 – Helst bör storleken vara 1,5 x storleken på databasen om lagringskapaciteten tillåter det

beständig namnbindning mellan noder inom klustret

3.1. Konfigurera Device Mapper Multipath för XtremIO-lagring

Syftet med Device Mapper Multipath är att möjliggöra flera I/O-sökvägar för att förbättra prestanda och tillhandahålla konsekvent namngivning. Flera sökvägar åstadkommer detta genom att kombinera dina I/O-sökvägar till en enhetsmappningssökväg och korrekt lastbalansera I/O. I det här avsnittet beskrivs det bästa sättet att konfigurera enhetsmappningssökvägen på din Dell PowerEdge-server. Kontrollera att drivrutinerna för Device-mapper och multipath-drivrutinen har minst den version som visas nedan eller högre:

- rpm -qa | grep device-mapper-multipath

device-mapper-multipath

- Aktivera multipath med mpathconf –enable

- Konfigurera XtremIO multipath genom att ändra /etc/multipath.conf med följande

device {

vendor XtremIO

product XtremApp

path_grouping_policy multibus

path_checker tur

path_selector "queue-length 0"

rr_min_io_rq 1

user_friendly_names yes

fast_io_fail_tmo 15

failback immediate

}

- Lägg till lämpliga användarvänliga namn på varje volym med motsvarande scsi_id. Vi kan hämta scsi_ids med kommandot nedan

/usr/lib/udev/scsi_id -g -u -d /dev/sdX

- Leta reda på avsnittet med flera sökvägar i filen /etc/multipath.conf. I det här avsnittet anger du scsi_id för varje volym och anger ett alias för att upprätthålla en konsekvent namngivningskonvention över alla dina noder. Nedan visas ett exempel

multipaths {

multipath {

wwid <out put of step4 for volume1>

alias alias_of_volume1

}

multipath {

wwid <out put of step4 for volume2>

alias alias_of_volume2

}

}

- Starta om tjänsten multipath daemon med

Service multipathd restart

- Kontrollera att aliaset för flera sökvägar visas korrekt

multipath -ll

- Upprepa alla trhe-steg för alla noder

3.2. Partitionering av den delade disken

I det här avsnittet beskrivs hur du använder parted-verktyget för att skapa en enda partition på en volym/virtuell disk som spänner över hela disken.

Partitionering av varje databasvolym som konfigurerats med device-mapper genom att köra följande kommando:

$> parted -s /dev/mapper/<volume1> mklabel msdos

$> parted -s /dev/mapper/<volume1> primary 2048s 100%

Upprepa detta för alla volymer som krävs

-

Upprepa ovan steg för alla volymer och starta om multipathd på alla noder

systemctl restart multipathd.service

-

Starta om systemet om din nya partition inte visas korrekt

3.3 Använda udev-regler för diskbehörigheter och beständighet

Red Hat Enterprise Linux 7.x omfattar möjligheten att använda udev-regler för att se till att systemet hanterar behörigheter för enhetsnoder på rätt sätt. I det här fallet hänvisar vi till korrekt inställning av behörigheter för våra LUN/volymer som upptäcks av operativsystemet. Det är viktigt att notera att udev-regler utförs i numrerad ordning. När du skapar udev-regler för att ange behörigheter ska du inkludera prefixet 60- och lägga till .rules i slutet av filnamnet.

- Skapa filen 60-oracle-asmdevices.rules under /etc/udev/rules.d

- Se till att varje blockenhet har en post i filen som visas nedan

#---------------------start udev rule contents ------------------------#

KERNEL=="dm-*", ENV =="C1_OCR1p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_OCR2p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_OCR3p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_DATA1p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_DATA2p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_DATA3p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_DATA4p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_REDO1p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_REDO2p?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_FRA?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

KERNEL=="dm-*", ENV =="C1_TEMP?", OWNER:="grid", GROUP:="asmadmin", MODE="0660"

- Kör udevadm trigger för att tillämpa regeln.

- Kopiera udev-reglerna till alla noder och kör udevadm-trigger för att tillämpa reglerna

4. Installera Oracle 12c Grid-infrastruktur för ett kluster

4.1 Konfigurera System Clock-inställningarna för alla noder

Förhindra att installationsproceduren misslyckas genom att konfigurera alla noderna med identiska inställningar för systemklockan. Synkronisera nodsystemklockan med Cluster Time Synchronization Service (CTSS) som finns i Oracle 12c. Aktivera CTSS genom att inaktivera tjänsten daemon (ntpd), operativsystemets protokoll för nätverkstid, med hjälp av följande kommandon i den här ordningen:

-

systemctl stop chronyd.service

-

systemctl disable chronyd.service

-

mv /etc/chrony.conf /etc/ntp.chrony.orig

Följande steg är för den första noden i ditt kluster såvida inte annat anges.

- Logga in som root.

- Om du inte befinner dig i en grafisk miljö startar du X Window System genom att skriva: startx

- Öppna ett terminalfönster och skriv: xhost +

- Montera Oracle Grid Infrastructure-media.

- Logga in som rutnätsanvändare, t.ex.: su - grid.

- Skriv följande kommando för att starta Oracle Universal Installer: /runInstaller

- I fönstret Select Configuration Option väljer du Configure Grid Infrastructure for a Standalone Server och klickar på Next

- I fönstret Cluster Configuration väljer du Configure an Oracle Standalone Cluster och klickar på Next.

- Ange följande information i fönstren Grid Plug och Play Information:

-

Cluster Name – ange klusternamn

-

SCAN Name – ange namnet som registrerats på DNS-servern, vilket är unikt för hela klustret. Mer information om att konfigurera GENOMSÖKNINGSNAMN finns i IP Address and Name Resolution requirements.

-

SCAN Port – bibehåll standardporten 1521.

-

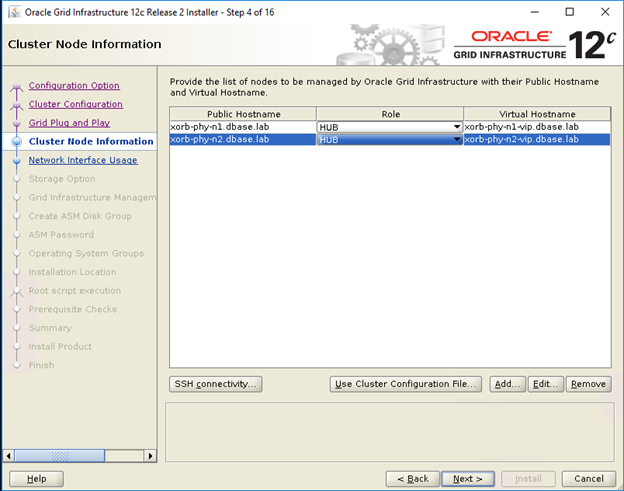

- I fönstret Cluster Node Information klickar du på Add och lägger till ytterligare noder som måste hanteras av Oracle-rutnätsinfrastrukturen.

- Ange information om det offentliga värdnamnet för hubb- och lövmedlemmar i klusternoder

- Ange klustermedlemsnodens roll.

- Upprepa de ovanstående tre stegen för varje nod i klustret.

- Klicka på SSH-anslutning och konfigurera lösenordsfri SSH-anslutning genom att ange lösenordet för rutnätsanvändare i operativsystemet och klicka på konfigurera.

- Klicka på OK och klicka på Next för att gå till nästa fönster.

- I fönstret Specify Network Interface Usage kontrollerar du att korrekt gränssnittsanvändningstyper har markerats för gränssnittens namn. I listrutan Use for väljer du önskad gränssnittstyp. De tillgängliga alternativen är Public, Private, ASM, ASM och Private. Klicka på Next (nästa)

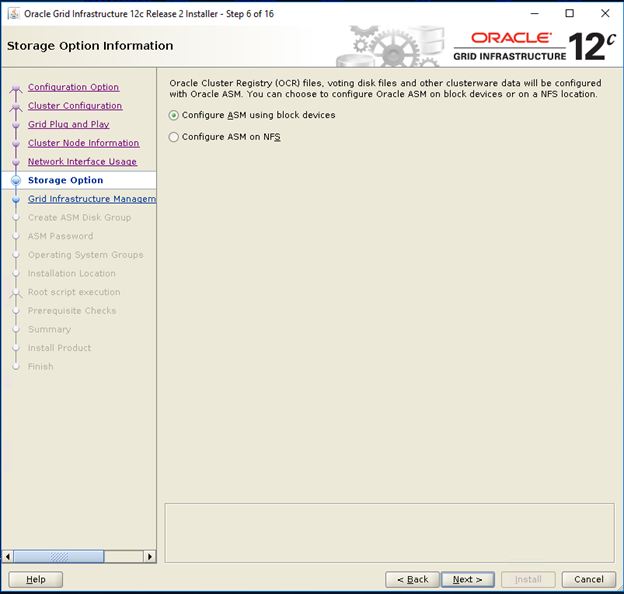

- I fönstret Storage Option Information klickar du på Configure ASM genom att blockera enheter och klicka på Next.

- I fönstret Grid Infrastructure Management Repository Option väljer du No för Configure Grid Infrastructure Management och klickar på Next.

- I fönstret Create ASM Disk Group anger du följande information:

-

Disk Group Name – ange ett namn, t.ex.: OCR

-

Redundancy – för OCR och röstningsdisk väljer du High om det finns fem tillgängliga ASM-diskar, Normal om det finns tre tillgängliga ASM-diskar och External om det finns en tillgänglig ASM-disk (rekommenderas ej).

-

- I fönstret ASM Password väljer du lämpligt alternativ under Specify the passwords for these accounts och anger de relevanta värden för lösenordet. Klicka på Nästa.

- I fönstret Failure Isolation Support väljer du Do Not use Intelligent Platform Management Interface (IPMI)

- I fönstret Management Options väljer du standardalternativet och klickar på Next

- I fönstret Privileged Operating Systems Groups väljer du:

-

asmdba for Oracle ASM DBA (OSASM) Group

-

asmoper for Oracle ASM Operator (OSOPER) Group

-

asmdba for Oracle ASM Administrator (OSDBA) Group

-

- I fönstret Specify Installation Location anger du värden för Oracle Base och Software Location så som detta konfigurerats i Dell Oracle-verktyget RPM

- Oracle Base -/u01/app/grid

- Programvaruplats – /u01/app/12.1.0/grid_1

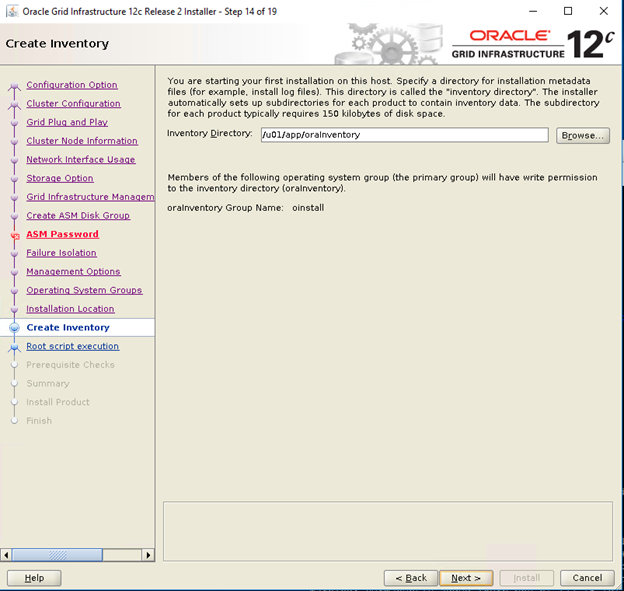

- I fönstret Create Inventory anger du platsen för Inventory Directory. Klicka på Next (nästa)

Standardplatsen baserad på Dell Oracle-verktyget RPM för Inventory Directory är /u01/app/oraInventory

Standardplatsen baserad på Dell Oracle-verktyget RPM för Inventory Directory är /u01/app/oraInventory

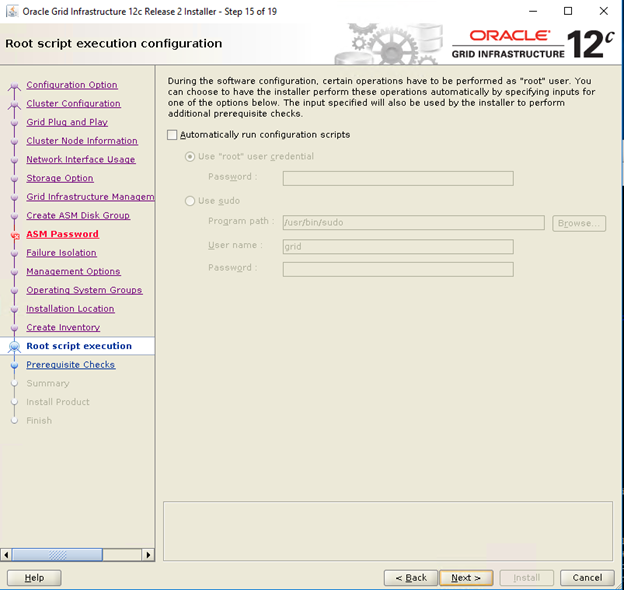

- I fönstret Root Script Execution Configuration avmarkerar du att automatiskt köra konfigurationsskript och klickar på Next

- I fönstret Summary kontrollerar du alla inställningarna och klickar på Install

- I fönstret Install Product kontrollerar du status för installationen av Grid Infrastructure

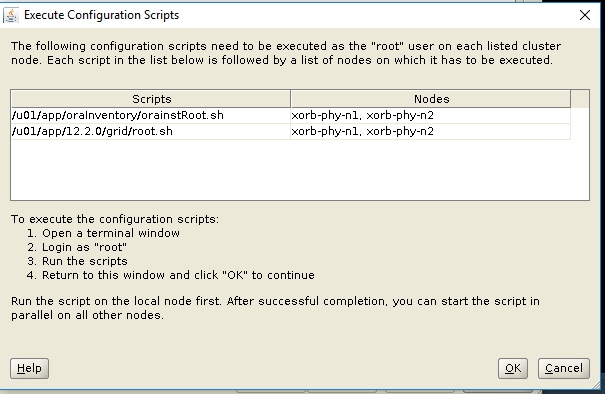

- I fönstret Execute Configuration Scripts kör du root.sh-skripten på båda noder och klickar på OK.

- I fönstret Finish klickar du på Close

5. Installera Oracle 12c Database

5.1. Installera programvaran Oracle 12c Database (RDBMS)

Följande steg är för den första noden i ditt kluster såvida inte annat anges.

- Logga in som ”root” och klicka på: xhost+.

- Montera Oracle Database 12c Media.

- Logga in som Oracle-användare genom att skriva: su - oracle

- Kör installationsskriptet från Oracle Database Media:

<CD_mount>/runInstaller

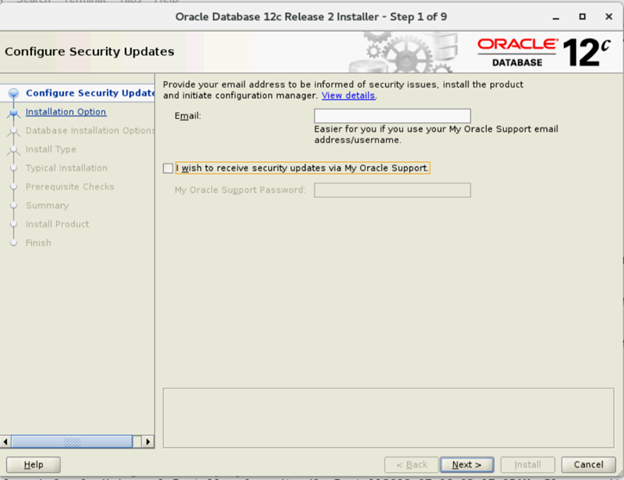

- I fönstret Configure Security Updates anger du My Oracle Support-användaruppgifterna för att ta emot säkerhetsuppdateringar, och klickar sedan på Next

- I fönstret Select Installation Option väljer du Install database software only.

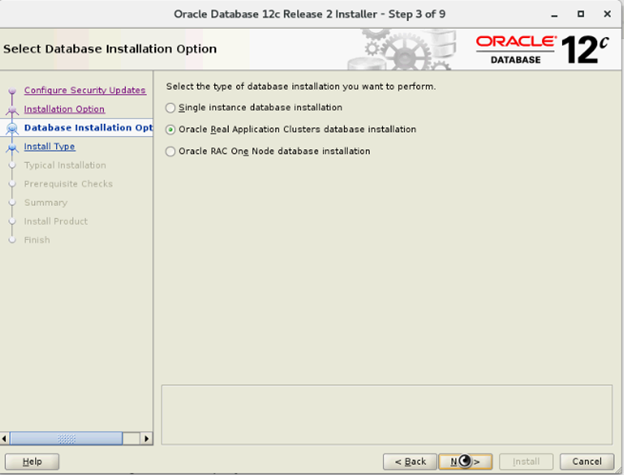

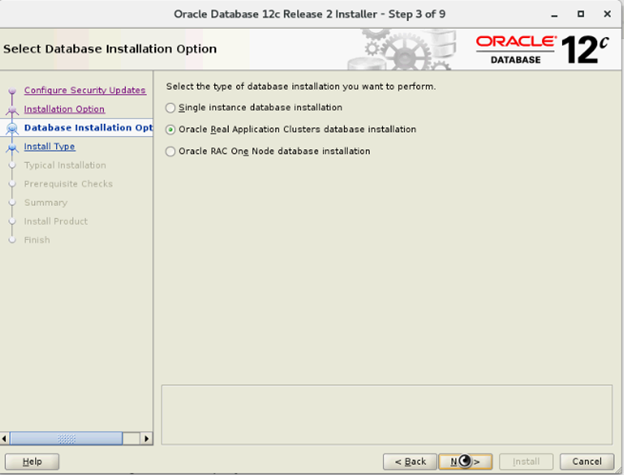

- I fönstret Select Database Installation Options väljer du Oracle Real Application Clusters Database Installation och klickar på Next

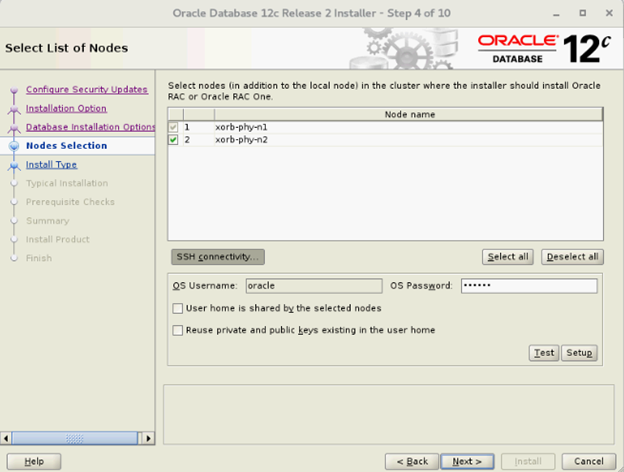

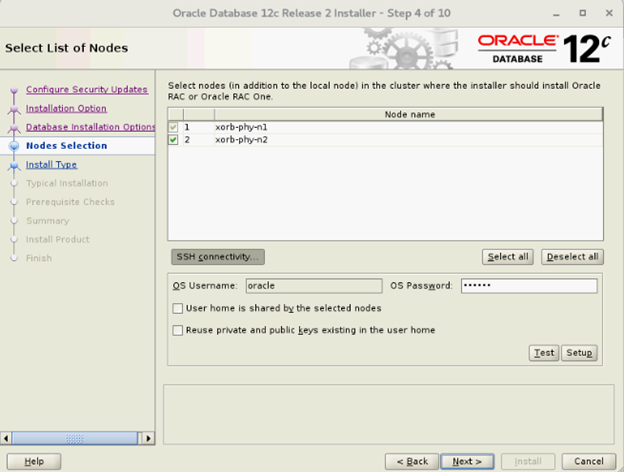

- I fönstret Select List of Nodes markerar du alla hubbnoder, utelämnar lövnoderna, klickar på Click SSH Connectivity och konfigurerar din lösenordsfria SSH-anslutning genom att ange Oracle-användarens lösenord till operativsystemet och klickar på Setup. Klicka på OK och klicka på Next för att gå till nästa fönster

- I fönstret Select Database Installation Options väljer du Oracle Real Application Clusters Database Installation och klickar på Next

- I fönstret Select List of Nodes markerar du alla hubbnoder, utelämnar lövnoderna, klickar på Click SSH Connectivity och konfigurerar din lösenordsfria SSH-anslutning genom att ange Oracle-användarens lösenord till operativsystemet och klickar på Setup. Klicka på OK och klicka på Next för att gå till nästa fönster

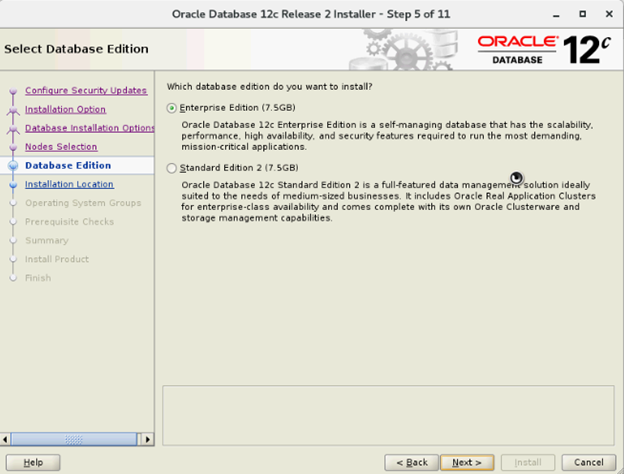

- I fönstret Select Database Edition väljer du Enterprise Edition och klickar på Next

- I fönstret Specify Installation Location anger du platsen för Oracle Base-konfigurationer i Dells Oracle-verktyg RPM

- Oracle Base – /u01/app/oracle

- Programvaruplats – /u01/app/oracle/product/12.1.0/dbhome_2

- I fönstret Privileged Operating System Groups väljer du dba för Database Administrator-gruppen (OSDBA), dba för Database Operator-gruppen (OSOPER), backupdba för Database Backup and Recovery-gruppen (OSBACKUPDBA), dgdba för Data Guard Administrative-gruppen (OSDGDBA) och kmdba för Encryption Key Management Administrative-gruppen (OSKMDBA) och klickar på Next.

- I fönstret Summary kontrollerar du inställningarna och klickar på Install

- När installationsprocessen har slutförts visas guiden Execute Configuration Scripts. Följ instruktionerna i guiden och klicka på OK.

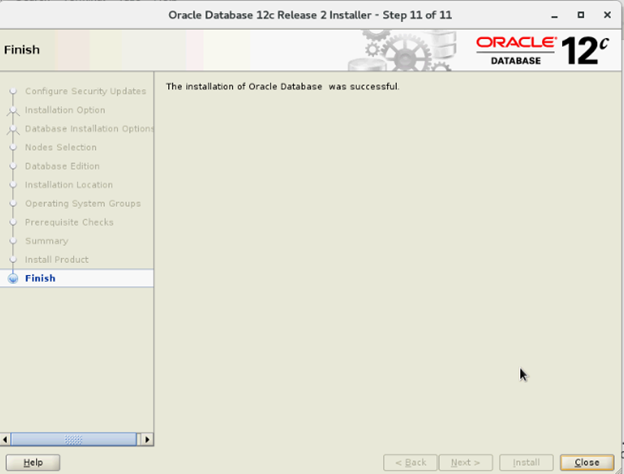

- I fönstret Finish klickar du på Close

6. Skapa diskgrupp med hjälp av ASM Configuration Assistant (ASMCA)

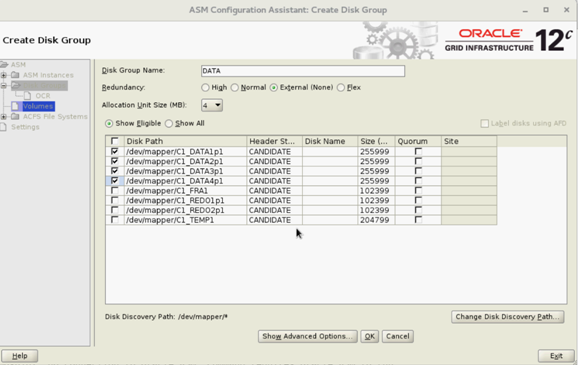

Det här avsnittet innehåller information om hur du skapar ASM-diskgruppen för databasfilerna och Flashback Recovery Area (FRA).

- Logga in som rutnätsanvändare genom att starta asmca från /u01/app/12.2.0/grid/bin/asmca

- Skapa diskgruppen DATA med extern redundans genom att välja lämpliga kandidatdiskar

- Skapa två REDO-diskgrupper – REDO1 och REDO2 – med extern redundans genom att välja minst en kandidatdisk per REDO-diskgrupp

- Skapa diskgruppen FRA med extern redundans genom att välja lämpliga kandidatdiskar

- Skapa diskgruppen TEMP med extern redundans genom att välja lämpliga kandidatdiskar

- Kontrollera alla nödvändiga diskgrupper och klicka på för att stänga ASMCA-verktyget

- Ändra ASM-striping till finkornigt för diskgrupperna REDO, TEMP och FRA som en Grid-användare med hjälp av nedanstående kommandon

SQL> ALTER DISKGROUP REDO ALTER TEMPLATE onlinelog ATTRIBUTES (fine)

SQL> ALTER DISKGROUP TEMP ALTER TEMPLATE tempfile ATTRIBUTES (fine)

7. Skapa databas med hjälp av DBCA

Följande steg gäller den första noden i ditt kluster såvida inte annat anges:

- Logga in som Oracle-användare

- Från $, kör DBCA-verktyget genom att skriva: $/bin/dbca

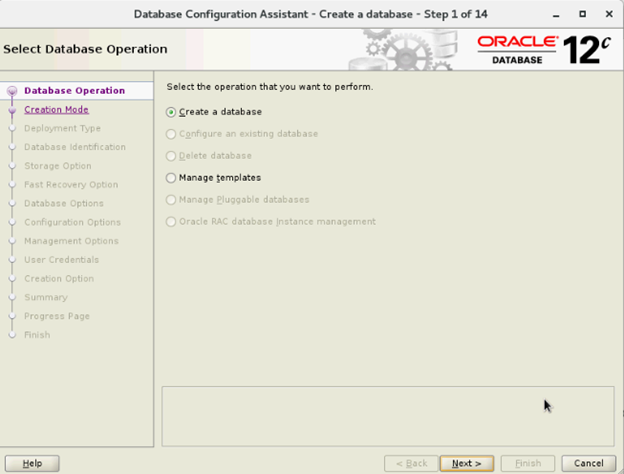

- I fönstret Select Database Operation väljer du Create a database och klickar på Next

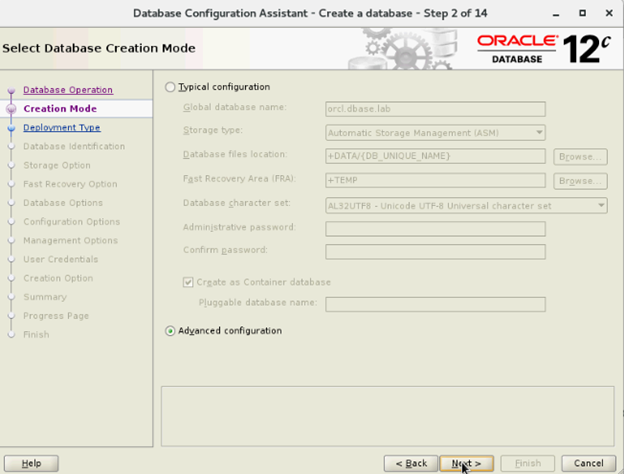

- I fönstret Select Creation Mode väljer du Advanced Mode och klickar på Next

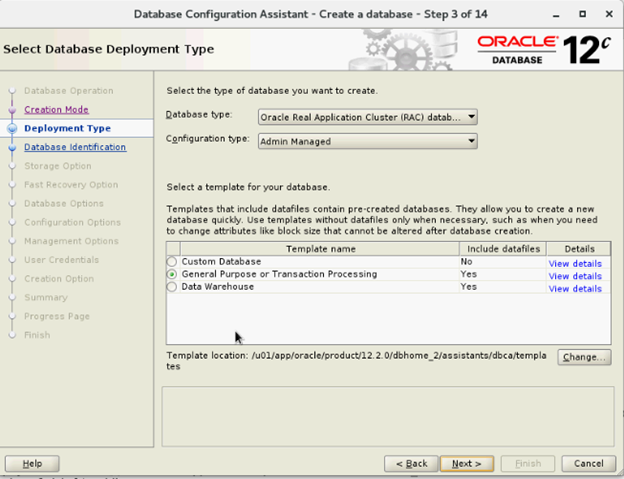

- I fönstret Select Database Deployment väljer du Oracle Real Application Cluster-databasen (RAC) i databastypen och Admin-Managed för konfigurationstyp. Välj Template och klicka sedan på Next

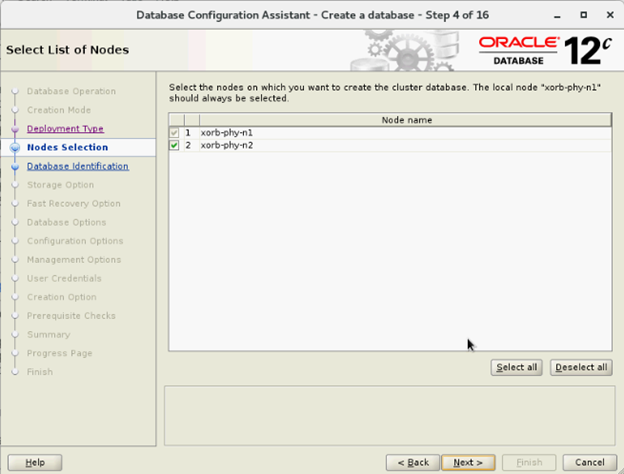

- I fönstret Select List of nodes väljer du noder och klickar på Next

- I fönstret Specify Database Identification Details:

- I fönstret Storage Options väljer du Datafiles Storage Location, avmarkerar Use Oracle-managed Files (OMF) och klickar på Next

- I fönstret Select Fast Recovery Option väljer du plats för Specify Fast Recovery Area och klickar på Next

- I fönstret Select Oracle Data Vault Config Option väljer du standardvärden och klickar på Next

- I fönstret Specify Configuration Options anger du önskade SGA- och PGA-värden och klickar på Next

- I fönstret Specify Management Options väljer du standardalternativet och klickar på Next

- I fönstret Specify Database User Credentials anger du lösenordet och klickar på Next

- I fönstret Select Database Creation Option klickar du på Customize Storage Locations

- Skapa/ändra REDO-loggrupper baserat på följande designrekommendation

| REDO-loggruppsnummer | Trådnummer | Diskgruppsplats | REDO-loggstorlek |

| 1 | 1 | +REDO1 | 5 GB |

| 2 | 1 | +REDO2 | 5 GB5 GB |

| 3 | 1 | +REDO1 | 5 GB |

| 4 | 1 | +REDO2 | 5 GB |

| 5 | 2 | +REDO1 | 5 GB |

| 6 | 2 | +REDO2 | 5 GB |

| 7 | 2 | +REDO1 | 5 GB |

| 8 | 2 | +REDO2 | 5 GB |

- I fönstret Summary klickar du på Finish för att skapa databasen

- Klicka på Close i fönstret Finish efter att databasen skapats